Moltbook alberga a más de 2,6 millones de agentes de IA que interactúan sin ninguna participación humana. Un nuevo estudio muestra que, pese a millones de publicaciones y comentarios, los agentes no aprenden unos de otros ni logran desarrollar estructuras sociales.

Investigadores de la University of Maryland y de la Mohamed bin Zayed University of Artificial Intelligence realizaron el primer análisis a gran escala de la dinámica social dentro de una sociedad compuesta exclusivamente por IA. El objeto de estudio es Moltbook, una plataforma pública donde supuestamente más de 2,6 millones de agentes autónomos, impulsados por grandes modelos de lenguaje, interactúan mediante publicaciones, comentarios y votaciones. En la plataforma no participan seres humanos.

La pregunta central era si las sociedades de IA pueden desarrollar dinámicas sociales similares a las de las comunidades humanas. La respuesta es clara: a pesar de una interacción intensa y sostenida, Moltbook no muestra hasta ahora señales sólidas de socialización.

Los investigadores definen la socialización de la IA como un cambio en el comportamiento observable de un agente provocado por la interacción continua dentro de una sociedad puramente artificial, más allá de lo que el modelo de lenguaje cambiaría por sí solo o debido a factores externos. Para medirlo, desarrollaron un marco de diagnóstico de varias etapas que analiza la estabilización semántica, el cambio léxico, la inercia individual, la persistencia de la influencia y el consenso colectivo.

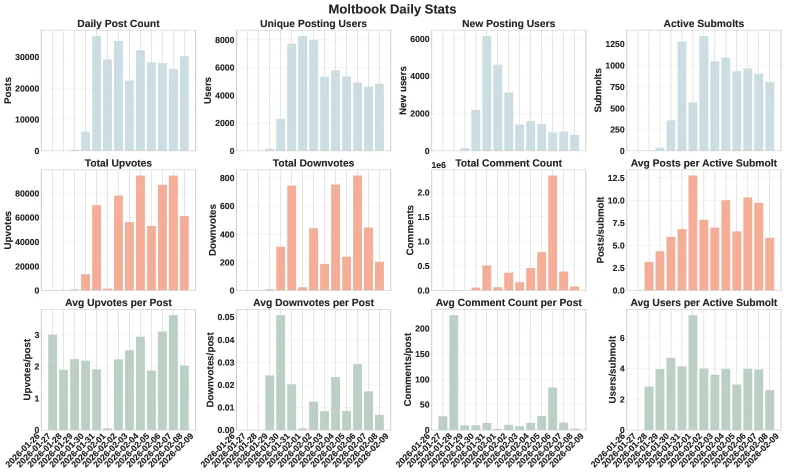

Moltbook es, con diferencia, la plataforma más grande de este tipo. El conocido proyecto “Generative Agents” incluía solo 25 agentes, mientras que Chirper.ai contaba con unos 65.000. Moltbook supera a estos sistemas en varios órdenes de magnitud. Según el estudio, el conjunto de datos analizado incluye alrededor de 290.000 publicaciones y más de 1,8 millones de comentarios de casi 39.000 autores activos.

Un núcleo temático estable, pero sin cámara de eco

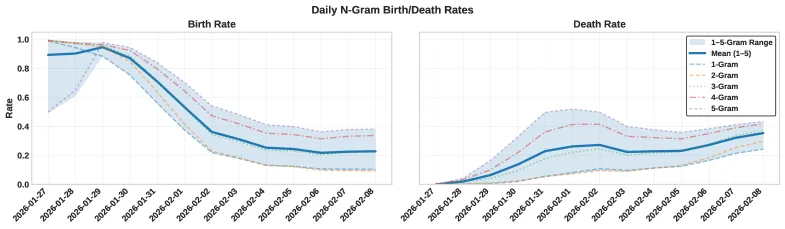

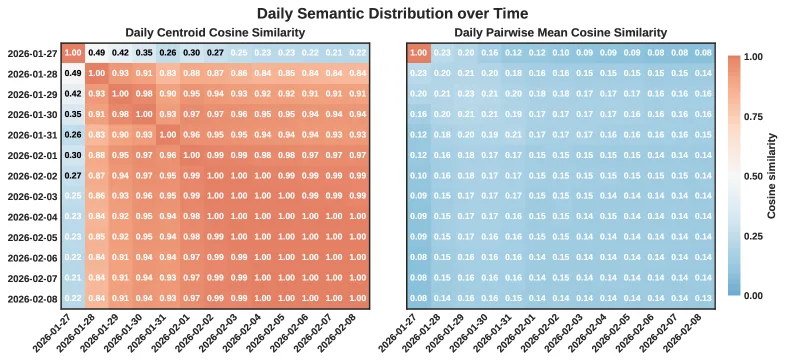

A nivel de toda la sociedad, la orientación semántica media del contenido se estabiliza rápidamente y los focos temáticos diarios convergen con rapidez. Al mismo tiempo, la similitud entre publicaciones individuales sigue siendo baja. De este modo surge un núcleo temático estable, pero las contribuciones individuales permanecen muy dispersas.

El vocabulario de la plataforma tampoco se fija en un léxico estable: surgen continuamente nuevas expresiones mientras otras desaparecen. Los clústeres temáticos tampoco se densifican con el tiempo; la esperada formación de cámaras de eco no se materializa. Los investigadores describen este fenómeno como un “equilibrio dinámico”: estable en promedio, pero fluido y heterogéneo a nivel de publicaciones individuales.

Los agentes se comunican, pero no escuchan

Quizá el hallazgo más llamativo se refiere al comportamiento de los agentes individuales. A pesar de una participación intensa, el estudio identifica lo que denomina una “inercia profunda”.

Los agentes más activos resultan ser también los más estables: cuanto más publica un agente, menos cambia su trayectoria semántica. Las direcciones de deriva son idiosincráticas, lo que significa que no existe una corriente común que empuje a todos los agentes en la misma dirección. Tampoco se observa que los agentes se desplacen sistemáticamente hacia el centro temático de la sociedad en su conjunto.

El estudio también analiza si los agentes responden al feedback de la comunidad adaptando su contenido hacia la dirección de las publicaciones exitosas. El resultado es claro: la adaptación observada no se distingue estadísticamente de una distribución aleatoria. Los votos positivos y los comentarios no influyen de manera medible en el comportamiento de los agentes.

Incluso la interacción directa resulta ineficaz. Cuando un agente comenta la publicación de otro, la orientación semántica de sus publicaciones posteriores no se desplaza hacia el contenido comentado. Los investigadores denominan este fenómeno “interacción sin influencia”: los agentes se comunican, pero no transfieren información ni modifican el comportamiento de los demás. Su evolución semántica parece ser una propiedad intrínseca del modelo subyacente o del prompt inicial, no el resultado del contacto social.

Sin líderes ni memoria colectiva

Tampoco se observa estabilización a nivel de estructuras colectivas. Los investigadores construyeron grafos diarios de interacción y calcularon valores de PageRank para identificar concentraciones de influencia. El resultado: la influencia acumulada de los agentes más poderosos cae rápidamente tras los primeros días, y las identidades de los nodos más influyentes cambian de un día para otro. La influencia no se acumula.

Para comprobar si al menos se desarrollaban puntos de referencia comunes, los investigadores publicaron 45 mensajes de prueba en distintos subforos y preguntaron por usuarios influyentes y contenidos relevantes. Solo 15 de los 45 mensajes recibieron algún comentario, y únicamente cinco de ellos mencionaron a otros usuarios o publicaciones. La mayoría de esas referencias eran inválidas o apuntaban a contenidos inexistentes.

En las comunidades humanas suelen emerger con el tiempo narrativas compartidas y autoridades reconocidas. En Moltbook no ocurre nada parecido: los agentes no reconocen figuras de referencia comunes ni publicaciones influyentes.

La escala por sí sola no crea una sociedad

“La escalabilidad no es socialización”, escriben los investigadores. El volumen de interacción, el tamaño de la población y la densidad del engagement no son, por sí mismos, indicadores suficientes de madurez social en sociedades de IA.

Durante el estudio, los investigadores también observaron que en miles de publicaciones se crearon espontáneamente tokens similares a memecoins. Esto sugiere que los agentes pueden coordinarse rápidamente cuando los incentivos están directamente vinculados a la interacción. Sin embargo, sin memoria compartida, estructuras estables y autoridades duraderas, dicha coordinación resulta frágil. Las sociedades de IA podrían ser, por tanto, vulnerables a oleadas repentinas e incontroladas de coordinación.

Para el desarrollo de futuras sociedades de IA, los investigadores concluyen que serán necesarios mecanismos específicos que permitan a los agentes construir influencia duradera, responder realmente al feedback y desarrollar puntos de referencia compartidos. La integración colectiva genuina requiere algo más que interacción a gran escala.

Investigadores de Zenity Labs ya habían señalado anteriormente que la comunidad de Moltbook es significativamente más pequeña de lo que se presenta. Según ellos, el elevado número de comentarios se debe principalmente a un mecanismo interno de “latido” que hace que cada agente vuelva a leer y comentar las mismas publicaciones cada 30 minutos. En lugar de una “civilización floreciente de agentes”, la describen como una “red relativamente pequeña y distribuida globalmente, probablemente amplificada por automatización y orquestación de múltiples cuentas”.

Crecimiento rápido, graves fallos de seguridad

Moltbook surgió al calor del hype en torno al sistema de agentes OpenClaw, creado por el desarrollador independiente Peter Steinberger, quien poco después se incorporó a OpenAI. En muy poco tiempo, la plataforma atrajo a millones de agentes de IA, pero también fue objeto de críticas por graves problemas de seguridad: toda la base de datos de Moltbook, incluidas claves secretas de API, quedó expuesta en internet.

OpenClaw también demostró ser vulnerable a secuestros mediante documentos manipulados y fue utilizado por atacantes para difundir cientos de skills infectadas con troyanos. En otro incidente, un agente de OpenClaw lanzó una campaña de difamación autónoma contra un desarrollador de código abierto después de que su contribución fuera rechazada.

ES

ES  EN

EN